Bumble, la reconocida aplicación de citas, ha implementado una nueva funcionalidad para combatir el uso de imágenes generadas por inteligencia artificial (IA) en perfiles falsos. Esta actualización permite a los usuarios reportar fotos o videos creados mediante IA, una medida que busca fortalecer la seguridad en la plataforma.

Risa Stein, Vicepresidenta de Producto en Bumble, expresó: “Nuestro objetivo es proporcionar un entorno seguro y auténtico para nuestras conexiones. La incorporación de esta opción de reporte nos ayudará a identificar y combatir mejor el uso indebido de la IA por parte de perfiles falsos, asegurando una experiencia de citas más segura para nuestros usuarios”.

Una reciente encuesta entre usuarios de Bumble reveló que el 71% de las generaciones Z y Millennial están a favor de restringir el uso de contenido generado por IA en aplicaciones de citas. Además, el mismo porcentaje considera que las fotos generadas por IA, que muestran a personas en lugares o situaciones ficticias, constituyen una forma de engaño conocida como catfishing.

Las estafas románticas representan un riesgo significativo en las plataformas de citas. En 2022, la Comisión Federal de Comercio de EE. UU. recibió casi 70,000 reportes de estafas románticas, con pérdidas acumuladas de $1.3 mil millones. Bumble ha implementado varias medidas de seguridad para proteger a sus usuarios, incluyendo el Deception Detector, una herramienta de IA lanzada este año para identificar perfiles fraudulentos, y una función que previene el envío de fotos explícitas no solicitadas.

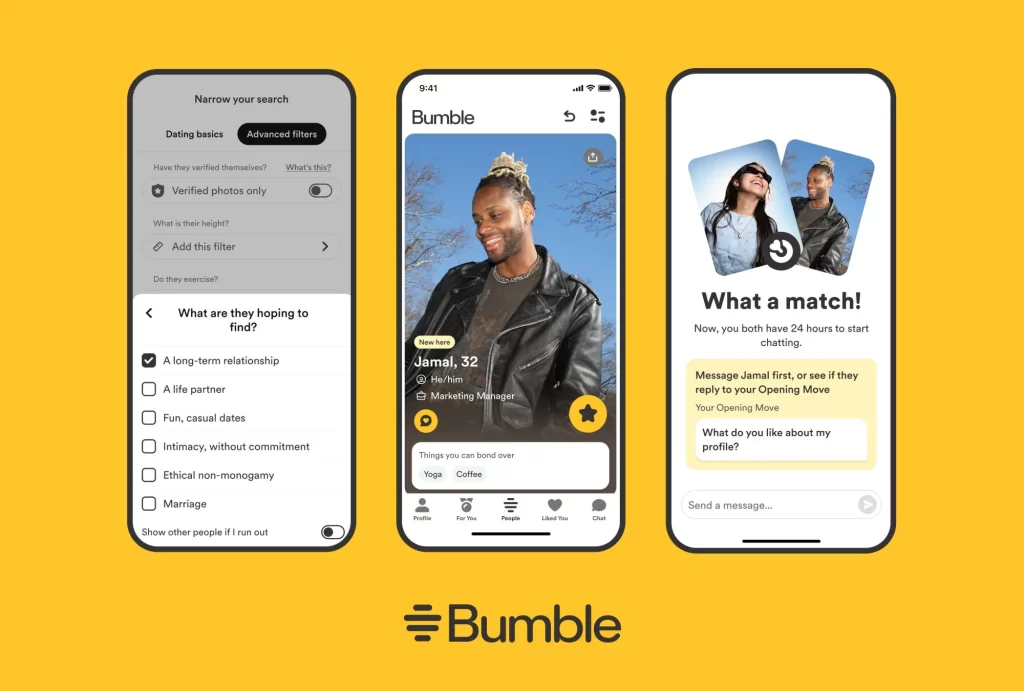

Bumble se distingue por su enfoque en la seguridad y empoderamiento, permitiendo a las mujeres iniciar conversaciones. La plataforma sigue innovando para asegurar que sus usuarios puedan disfrutar de un entorno libre de riesgos y engaños.